Supercomputer im Zeitalter von KI: Warum wir mehr Rechenleistung brauchen

Supercomputer stehen traditionell für die Spitzenklasse der Rechenleistung – Anlagen, die ganze Hallen füllen und bislang nur in nationalen Forschungszentren oder für hochkomplexe Simulationen genutzt wurden. Doch mit dem Durchbruch von Künstlicher Intelligenz (KI) und Large Language Models (LLMs) hat sich das Bild verändert. Heute benötigen nicht nur Universitäten, sondern auch Unternehmen Zugang zu massiver Rechenleistung.

Training und Einsatz von Modellen mit Hunderten von Milliarden Parametern stellen selbst große Cloud-Infrastrukturen vor Herausforderungen. Gleichzeitig wächst das Bedürfnis, KI-Systeme on-premises zu betreiben, sei es aus Gründen des Datenschutzes oder um Kosten und Latenzen besser im Griff zu haben.

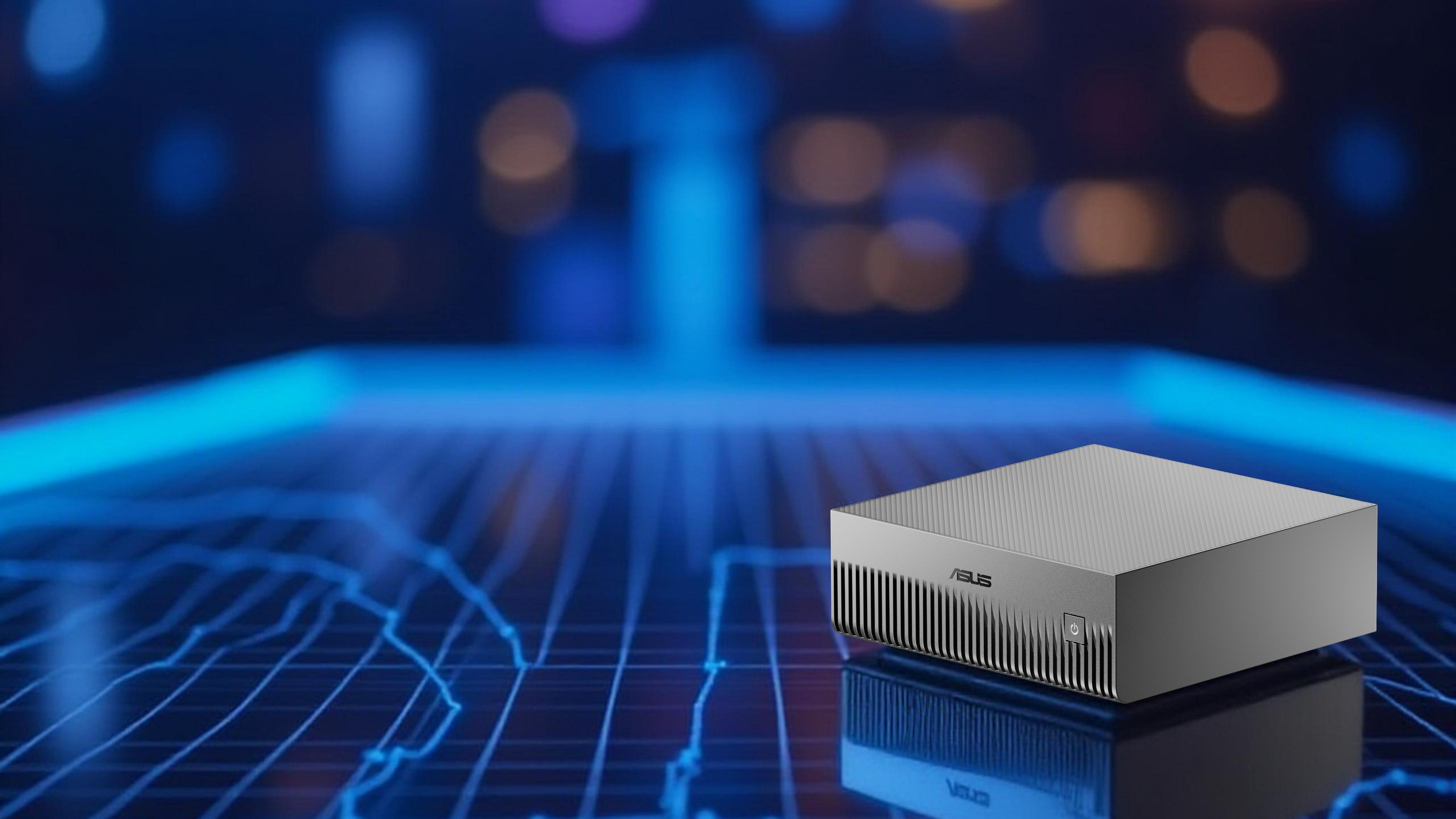

Mit dem ASUS Ascent GX10, auch bekannt als NVIDIA DGX Spark, startet ASUS in eine neue Ära des kompakten Supercomputings: ein Desktop-System, das Supercomputer-Power auf den Schreibtisch bringt – speziell für KI-Entwicklung, Training und Fine-Tuning offener LLMs.

Performance, Speicher & Netzwerk – die Power des GX10 im Detail

Das Herzstück des ASUS Ascent GX10 ist der NVIDIA GB10 Grace Blackwell Superchip – eine enge Integration aus ARM v9.2-A CPU und Blackwell-GPU, entwickelt speziell für KI-Workloads. Diese Architektur kombiniert hohe Rechenleistung mit Energieeffizienz und extrem kurzen Datenwegen – ideal für Deep-Learning-Aufgaben, LLM-Fine-Tuning und generative KI-Anwendungen.

Der GX10 liefert bis zu 1 PFLOP KI-Rechenleistung (FP4, sparse) und eignet sich damit für das Training, Fine-Tuning und die Ausführung großer offener Modelle wie:

-

Meta LLaMA 3

-

Mistral 7B / Mixtral

-

Falcon 180B

-

OpenHermes / OpenChat.

Neben diesen etablierten Open-Source-Modellen können auch offene OpenAI-Modelle und Community-Projekte lokal betrieben werden. Bei Kopplung von zwei GX10-Systemen sind Modelle mit bis zu 400 Milliarden Parametern möglich.

Im Gegensatz zu geschlossenen Modellen wie GPT-4, die aufgrund ihrer nicht zugänglichen Parameterarchitektur nicht lokal ausgeführt werden können, bieten offene Modelle volle Kontrolle über Daten, Anpassung und Fine-Tuning.

Der GX10 verfügt über 128 GB LPDDR5x Unified Memory und bis zu 4 TB NVMe SSD-Speicher (PCIe Gen5 x4). Damit lassen sich umfangreiche Datensätze effizient verwalten, auch im produktiven Dauerbetrieb.

Über 10G LAN, Wi-Fi 7, Bluetooth 5 und ConnectX CX-7 ist eine performante Netzwerk-Anbindung gewährleistet.

Ein leistungsstarkes fortschrittliches thermisches Design sorgt für Stabilität und leisen Betrieb – selbst bei Dauerlast.

Mit nur 150 × 150 × 51 mm Größe und 1,48 kg Gewicht bringt der GX10 echte Supercomputer-Power ins Desktop-Format.

Technische Daten

|

Komponente |

ASUS Ascent GX10 (NVIDIA DGX Spark) |

|

Superchip |

NVIDIA GB10 Grace Blackwell |

|

CPU |

ARM v9.2-A (12 Kerne) |

|

GPU |

NVIDIA Blackwell (integriert) |

|

Speicher |

128 GB LPDDR5x Unified Memory |

|

Storage |

1 TB / 2 TB / 4 TB NVMe SSD (PCIe Gen5 x4) |

|

Netzwerk |

10G LAN, Wi-Fi 7, Bluetooth 5, ConnectX CX-7 |

|

Kühlung |

Flüssigkeitskühlung (optimiert für Dauerbetrieb) |

|

Abmessungen |

150 × 150 × 51 mm |

|

Gewicht |

1,48 kg |

|

Betriebssystem |

NVIDIA DGX Base OS (Ubuntu Linux) |

|

I/O-Ports (Rückseite) |

3× USB-C (20 Gbps), 1× USB-C PD (180 W), 1× HDMI 2.1, 1× 10G LAN, 1× CX-7 |

Hier geht’s zum offiziellen ASUS Ascent GX10 Datenblatt (PDF)

Mit diesen Spezifikationen positioniert sich der ASUS Ascent GX10 klar zwischen klassischen Desktop-Systemen und großen Rechenclustern wie der NVIDIA DGX-Serie. Um die Leistungsfähigkeit einzuordnen, lohnt sich ein Blick auf den Vergleich mit dem DGX H100 und typischen Cloud-Instanzen:

|

Kriterium |

ASUS Ascent GX10 (NVIDIA DGX Spark) |

NVIDIA DGX H100 |

Cloud (AWS/Azure/Google) |

|

Rechenleistung (AI FP4) |

bis zu 1 PFLOP (sparse) |

ca. 0,5–0,7 PFLOP (FP16) |

Variabel (abhängig von Instanzen) |

|

Maximale Modellgröße |

bis 400B Parameter (bei 2 Systemen) |

bis ~175B Parameter |

Beliebig – abhängig von Kosten |

|

Energieeffizienz |

Sehr hoch (Grace Blackwell) |

Hoch (Ampere) |

Mittel – hoch |

|

Datenhoheit |

Vollständig On-Premises |

Vollständig On-Premises |

Externe Datenhaltung |

|

Investitionskosten |

Hoch (einmalig) |

Sehr hoch (einmalig) |

Keine (Pay-as-you-go) |

|

Laufende Kosten |

Gering (Strom & Kühlung) |

Gering (Strom & Kühlung) |

Hoch (laufend) |

|

Skalierbarkeit |

Sehr gut – 2 Systeme koppelbar |

Gut – Cluster möglich |

Sehr hoch – Cloud-Skalierung |

Kompakt, robust und effizient: Bauweise des GX10

Der ASUS Ascent GX10 ist kein klassischer Rack-Server, sondern ein kompakter Desktop-Supercomputer, der sich dank seines Formfaktors von nur 150 × 150 × 51 mm problemlos in bestehende Arbeitsumgebungen integrieren lässt – ganz ohne Rechenzentrumsumgebung.

Trotz seiner geringen Größe ist der GX10 für den Dauerbetrieb unter Volllast ausgelegt: Eine leistungsstarke Flüssigkeitskühlung sorgt dafür, dass das System auch bei intensiven KI-Workloads stabil, leise und energieeffizient bleibt.

Ein besonderes Merkmal ist die Skalierbarkeit. Zwei GX10-Systeme lassen sich koppeln, um größere Modelle zu trainieren oder komplexe Inferenzaufgaben zu bewältigen. Damit bietet ASUS eine modulare Lösung, die mit wachsenden Anforderungen Schritt hält – ein entscheidender Vorteil für Forschungseinrichtungen oder Unternehmen mit langfristiger KI-Strategie.

Auch bei der Konnektivität zeigt sich der GX10 zukunftssicher: PCIe Gen5, 10G LAN, Wi-Fi 7, Bluetooth 5 und die ConnectX CX-7 SmartNIC sorgen für schnelle Datenanbindung und nahtlose Integration in bestehende Netzwerke.

Zum Lieferumfang gehören das NVIDIA DGX Base OS, vorkonfigurierte KI-Frameworks (z. B. PyTorch, TensorFlow, Hugging Face) und Remote-Management-Tools – so ist das System nach dem Einschalten sofort einsatzbereit.

Von Forschung bis Unternehmen: Wo der GX10 seine Stärken ausspielt

Der ASUS Ascent GX10 ist für eine breite Palette an Anwendungsszenarien konzipiert – von wissenschaftlicher Forschung bis hin zu unternehmenskritischen KI-Workloads.

In der Forschung ermöglicht der GX10 das Training und Fine-Tuning komplexer Modelle – etwa für Sprachverarbeitung, Genomik oder Simulationen in der Physik. Universitäten und Institute profitieren besonders davon, dass Daten lokal verarbeitet werden können, ohne auf Cloud-Dienste angewiesen zu sein.

Auch Unternehmen können mit dem GX10 KI-Projekte intern realisieren – ob beim Aufbau von Agentic-AI-Systemen, der Automatisierung von Geschäftsprozessen oder der Entwicklung kundenspezifischer LLMs. Durch die Kombination aus Rechenleistung, Energieeffizienz und Datenschutz ist das System ideal für Umgebungen, in denen sensible Informationen das Haus nicht verlassen dürfen – etwa im Gesundheitswesen, bei Finanzdienstleistern oder in der öffentlichen Verwaltung.

Nicht zuletzt überzeugt der GX10 durch modulare Skalierbarkeit: Wer klein beginnt, kann sein System später durch die Kopplung mehrerer GX10-Einheiten erweitern und so Schritt für Schritt ein On-Premises-KI-Rechencluster aufbauen – mit voller Datenhoheit und planbaren Kosten.

Für wen lohnt sich der GX10 – und wo liegen die Grenzen?

Mit dem ASUS Ascent GX10 hat ASUS einen neuen Maßstab im kompakten KI-Supercomputing gesetzt. Der NVIDIA GB10 Grace Blackwell Superchip vereint extreme Rechenleistung mit hoher Energieeffizienz und bietet damit eine echte Alternative zu Cloud- oder Großsystemen.

Der GX10 eignet sich besonders für Forschungseinrichtungen, Start-ups und Unternehmen, die eigene KI-Modelle trainieren oder betreiben möchten, ohne Daten auszulagern. Auch für Entwicklerteams ist er ideal, um Prototypen, LLMs oder Agentic-AI-Anwendungen lokal zu entwickeln und zu testen.

Grenzen zeigt das System nur dort, wo massive Cluster-Workloads oder verteilte Trainings über Dutzende GPUs gefragt sind – hier bleibt der GX10 zwar koppelbar, erreicht aber nicht das Niveau eines kompletten DGX-H100-Clusters.

ASUS Ascent GX10 Supercomputer – Preise, Verfügbarkeit & Beratung

Möchtest du herausfinden, ob der ASUS Ascent GX10 auch für dein Unternehmen oder deine Forschung der richtige Schritt ist?

Besuchen Sie unsere Produktseite und fragen Sie Details an.

Alternativ bieten wir auch individuelle Beratung und unterstützen beim Aufbau maßgeschneiderter KI-Infrastrukturen.