Hailo-8 ist ein moderner KI-Beschleunigerchip für Deep Neural Networks. Hailo-8 ist insbesondere für Vision-Anwendungen geeignet. Das ist die M.2 M-key 2280 Variante des Hailo-8 AI Processors. Zum Betrieb wird eine Host-CPU benötigt.

Technische Daten

HAILO-8 AI Accelerator

- bis zu 26 TOPS INT8 performance (trillion operations per second = 26 Billionen Rechenoperationen pro Sekunde / 2,6 * 10^13 Rechenoperationen)

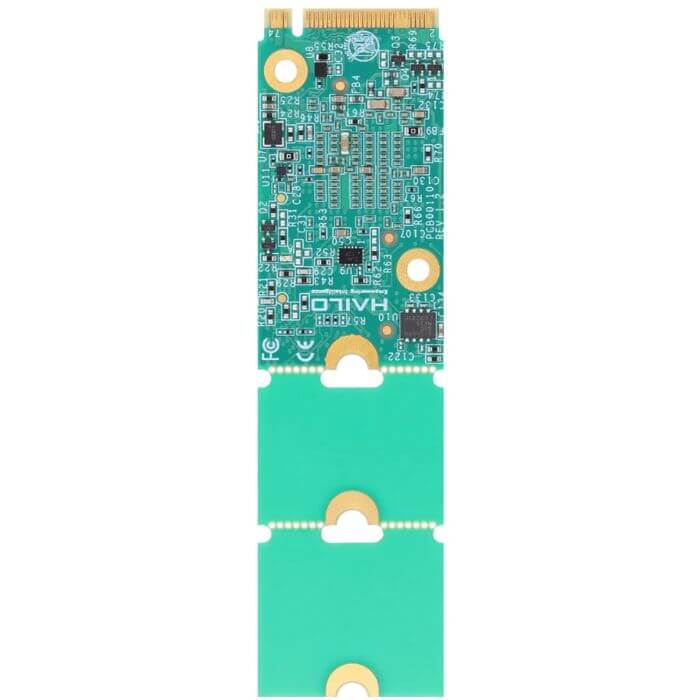

- Formfaktor: M.2 2280 M-Key

- Abmessungen: 22×80 mm

- kann durch abbrechen auf 22 x 42 mm oder 22 x 60 mm angepasst werden

- Interface: PCIe Gen-3.0, 4 Lanes (bis zu 32 Gbs)

-

TDP: 8.65 W (2.5 A @ 3.3V)

Softwareunterstützung (Inferencing)

- führt Deep Learning Neural Networks mit hoher Leistungseffizienz aus

- besonders gut für CNNs geeignet (Computer Vision Anwendungen)

- ermöglicht parallel mehrere Modelle & Streams zu prozessieren

- Linux, Windows

- Unterstützt TensorFlow, TensorFlow Lite, Keras, PyTorch, ONNX

- Kompatibel mit ARM und x86 Systemen.

Hinweise

- CE & FCC Class A zertifiziert

- Betriebstemperatur: 0°C - 70°C (Umgebungstemperatur) für die HM218B1C2FA Variante

- wird in zwei verschiedenen funktionsgleichen Varianten gebaut (aufgrund von zwei verschiedenen Lieferanten für Stromversorgungskomponenten), d.h. Abbildung kann abweichen, abgebildet ist die M2A Variante.

- Optional auch als Hailo-8 starter Kit M-Key erhältlich

(siehe HAILO Website als Grafikquelle mit Erklärung der Testparameter)

Für den Betrieb muss sichergestellt werden, dass die Hitze die das Hailo-8 Modul erzeugt abgeführt wird. Das Modul wurde so designed dass die meiste Hitze zur metallischen Abdeckung des Chips (Top Surface of the Package) hin abgeleitet wird. Wir empfehlen die Application Note "Hailo-8 AI Acceleration Module Thermal Design Considerations" zu lesen.

Dokumentation & Downloads

- HAILO-8 M.2 AI Acceleration Modules Product brief (PDF)

- Hailo Developer Zone

- Hailo Software Downloads - alles was benötigt wird um Hailo AI Prozessoren zu installieren und zu betreiben

- Hailo Dokumentation und Datenblätter

- Hailo Model Explorer - ermöglicht das passendste AI Modell als Basis für Ihre Anwendung zu wählen

- Hailo Community

- Hailo auf GitHub

Beratung durch buyzero

Wir beraten Sie ob Ihr Modell auf dem HAILO-8 lauffähig ist, und ob Sie Ihr Projekt mit Hilfe von HAILO-8 umsetzen können. Kontaktieren Sie uns dazu bitte.

FAQ

Was sind Beispielanwendungen für dieses Modul?

Man kann mit diesem Modul sogenannte Deep Learning Algorithmen, insbesondere CNNs (convolutional neural networks), beschleunigen.

Dazu gehören:

- Pose Estimation - Schätzung der Pose eines Menschen

- Objekterkennung mit Bounding Boxes (bspw. wo ist ein Fahrrad im Bild, und was ist es)

- Segmentierung - markiere die Bereiche eines Bildes die eine Banane einnimmt

- Nummernschilderkennung

- Gesichtserkennung

- u.v.m.

Kann ich Modelle für den HAILO-8L auch auf einem HAILO-8 laufen lassen?

Ja, das ist möglich! Modelle die für den HAILO-8L kompiliert worden sind laufen auch auf einem HAILO-8.

Ich benötige mehr TOPS, da ich eine komplexe Anwendung habe, was kann ich tun?

Dieses HAILO-8 Modul, hat 26 TOPS.

Wir bieten in unserem Shop auch eine Lösung mit 52 TOPS - das Biscotti Modul an. Es nutzt dazu zwei HAILO-8 Module, und hat einen EDSFF E1.S Anschluss - der in Storage Servern zum Einsatz kommt.

Dadurch kann das Biscotti Dual HAILO Modul auch in Clustern verbaut werden, und in einem 19'' Server bspw. auf 1600 TOPS skaliert werden. Wir stehen gerne bei Fragen zur Verfügung!

Ist der HAILO-8 eine gute Alternative zum Google Coral?

Ja, der HAILO-8 ist für Anwender mit höheren Leistungsansprüchen eine gute Alternative zur Google Coral Serie.

Google Coral kann hingegen gut in Anwendungen zum Einsatz kommen wo 4 TOPS Rechenleistung ausreichen, da sie günstiger sind.

Wozu sind die abbrechbaren Platinenteile gedacht?

In manchen Systemen können nur größere Module, bspw. M.2 2280 (80 mm) befestigt werden. Für andere Systeme wird diese zusätzliche Befestigungsmöglichkeit nicht benötigt.

Kann ich LLMs auf dem HAILO-8 ausführen, bpsw. LLAMA?

LLMs = Large Language Modelle (so etwas wie ChatGPT / GPT4-o, bzw. LLAMA, Falcon, usw.)

Nein, dafür ist der HAILO-8 nicht ausgelegt. Grafikkarten auf denen diese LLMs typischerweise laufen haben schnellen direkt angebundenen Speicher. Der HAILO-8 hat unter anderem nicht genügend Speicher, um diese Modelle laden zu können.

HAILO hat ein zukünftiges Produkt, den HAILO-10 angekündigt. Dieser wird eine Speicherschnittstelle haben, und auch GenAI Anwendungen wie LLMs besser unterstützen.

Kann ich damit Modelle trainieren?

Nein, der HAILO-8 ist ausschließlich für die Inferenz (int8) gedacht. Zum Training von Modellen wird typischerweise eine klassische GPU eingesetzt.

HAILO bietet hier Unterstützung mit einer Reihe von vorgebauten Docker-Containern, mit denen Modelle trainiert und auch angepasst werden können.

Das Model Build Environment wird wie im Diagramm gezeigt auf einem eigenen dafür vorgesehenen Computer betrieben, der über die notwendigen technischen Parameter verfügt. HAILO-8 selbst ist für Edge-Anwendungen gedacht, für die Inferenz, zusammen mit der HailoRT Runtime.

Wir unterstützen gerne bei technischen Fragen zu Modellen.

Physikalische Abmessungen

Alle Abmessungen in mm. Nur als Referenz, nicht für 3D-Modellierung geeignet.

Misc

- Hailo SKUs / alternative Bezeichnungen:

- HM218B1C2FAE = Hailo-8, M.2 module M key 2280 - ext. Temp. -40 to 85

- HM218B1C2FAE/HAI

- HM218B1C2FA = Hailo-8, M.2 module M key 2280 - commercial

Temp. 0 to 70 - HM218B1C2FA/HAI

- HS Code: 85176200

- Country of origin: Taiwan

- Packungsmenge einer Großverpackung: 20 (auf dieser Seite bestellen Sie ein Stück, wenden Sie sich bei Großbedarf gerne an uns)

- Lead Time (Nachlieferzeit): aktuell 12 Wochen

English Description

The Hailo-8 is a state-of-the-art AI accelerator chip designed for deep neural networks, especially for vision-based applications. This is the M.2 M-key 2280 variant of the Hailo-8 AI Processor, requiring a host CPU for operation.

Technical Specifications

- Model: HAILO-8 AI Accelerator

- Performance: Up to 26 TOPS INT8 (trillion operations per second = 26 billion operations per second / 2.6 × 10^13 operations)

- Form Factor: M.2 2280 M-Key (22×80 mm, adaptable to 22×42 mm or 22×60 mm by breaking)

- Interface: PCIe Gen-3.0, 4 lanes (up to 32 Gbps)

- TDP: 8.65 W (2.5 A @ 3.3V)

Software Support (Inferencing)

- Executes deep learning neural networks with high efficiency

- Best suited for CNNs (Computer Vision applications)

- Capable of processing multiple models and streams in parallel

- Supports Linux and Windows

- Compatible with TensorFlow, TensorFlow Lite, Keras, PyTorch, ONNX

- Supports ARM and x86 systems

Notes

- CE & FCC Class A certified

- Operating Temperature: 0°C to 70°C (ambient) for the HM218B1C2FA variant

- Available in two functionally identical variants due to the use of different suppliers for power components; illustrations may vary, shown is the M2A variant.

- Also available as a Hailo-8 M-key Starter Kit

Thermal Considerations

To ensure proper operation, heat generated by the Hailo-8 module must be dissipated. The module is designed to direct most of the heat to the metal surface of the chip (Top Surface of the Package). It is recommended to consult the application note "Hailo-8 AI Acceleration Module Thermal Design Considerations."

We provide consulting services to assess whether your model is compatible with HAILO-8 and whether your project can be implemented using HAILO-8. Please feel free to contact us for assistance.

FAQ

What are example applications for this module?

This module accelerates deep learning algorithms, particularly CNNs (convolutional neural networks). Examples include:

- Pose estimation

- Object detection with bounding boxes (e.g., identifying a bicycle in an image)

- Segmentation (marking image regions containing a banana)

- License plate recognition

- Face recognition

- And more.

Can I run models compiled for the HAILO-8L on a HAILO-8?

Yes, models compiled for the HAILO-8L can also run on a HAILO-8.

I need more TOPS for a complex application. What can I do?

This HAILO-8 module provides 26 TOPS. We offer a solution with 52 TOPS in our store — the Biscotti module, which uses two HAILO-8 modules and features an EDSFF E1.S connector used in storage servers. This enables the Biscotti dual HAILO module to be deployed in clusters, scaling up to 1600 TOPS in a 19" server. We are happy to assist with any questions!

Is the HAILO-8 a good alternative to Google Coral?

Yes, the HAILO-8 is a good alternative for users with higher performance requirements compared to the Google Coral series. However, Google Coral is more cost-effective for applications requiring only 4 TOPS.

What are the breakable PCB sections for?

In some systems, larger modules, such as M.2 2280 (80 mm), are required for installation. For other systems, this additional mounting option may not be necessary, allowing for the adjustment by breaking the PCB to fit 42 mm or 60 mm.

Can I run LLMs, such as LLAMA, on the HAILO-8?

LLMs (Large Language Models like ChatGPT, GPT-4, LLAMA, Falcon, etc.) are not designed to run on HAILO-8. GPUs used for LLMs typically feature fast, directly connected memory, which HAILO-8 lacks. Hailo has announced a future product, HAILO-10, which will include a memory interface to better support GenAI applications, including LLMs.

Can I train models on the HAILO-8?

No, the HAILO-8 is exclusively for inference (int8). Model training typically requires a traditional GPU. Hailo provides pre-built Docker containers for model training and adaptation.

The Model Build Environment is operated on a dedicated machine with the necessary technical specifications, as indicated in the diagram. HAILO-8 is designed for edge applications, particularly inference, using the HailoRT Runtime.

We are happy to assist with any technical questions regarding models.

Miscellaneous

Hailo SKUs / alternative designations:

- HM218B1C2FAE = Hailo-8, M.2 module M key 2280 - extended temperature range (-40 to +85°C)

- HM218B1C2FA = Hailo-8, M.2 module M key 2280 - commercial temperature range (0 to 70°C)

- HS Code: 85176200

- Country of Origin: Taiwan

Sicherheitsangaben

- Lesen Sie die Bedienungsanleitung sorgfältig durch, bevor Sie das Produkt verwenden.

- Stellen Sie sicher, dass alle Montage- und Installationsanweisungen des Herstellers sorgfältig befolgt werden.

- Verwenden Sie das Produkt nur für den vorgesehenen Zweck.

- Die unsachgemäße Nutzung dieses Produkts kann zu schweren Verletzungen oder Sachschäden führen.

- Nicht für Kinder unter 10 Jahren geeignet.

- Bei unsachgemäßer Verwendung besteht eine Verletzungsgefahr.

- Dieses Produkt entspricht den geltenden Sicherheitsanforderungen der Europäischen Union.

- Dieses Produkt wurde gemäß der GPSR geprüft, die sicherstellt, dass alle relevanten Sicherheitsanforderungen für Konsumgüter eingehalten werden.

Nachverfolgbarkeitsinformationen

Jedes Produkt verfügt über eines oder mehrere der folgenden Merkmale:

- Ein CE-Kennzeichen, das die Einhaltung der Sicherheits-, Gesundheits- und Umweltschutzanforderungen der Europäischen Union anzeigt.

- Eine eindeutige Serien- oder Chargennummer, um die Nachverfolgbarkeit zu gewährleisten und bei Bedarf Rückrufaktionen zu unterstützen.

- Hersteller- und Importeurangaben für den Kundensupport und Sicherheitsanfragen.

Überwachung und Berichterstattung von Vorfällen

Für den unwahrscheinlichen Fall eines Produktproblems haben wir Verfahren implementiert, um:

- Kundenbeschwerden zeitnah bearbeiten.

- Schwerwiegende Vorfälle über das EU Safety Gate/RAPEX-System melden.

- Mit den Marktüberwachungsbehörden zusammenarbeiten, um die öffentliche Sicherheit zu gewährleisten.

Kontakt:

- Email: support [@] pi3g.com

- Telefon: 0341 / 392 858 40

Dieses Produkt ist vollständig mit allen geltenden EU-Vorschriften konform, um die Sicherheit unserer geschätzten Kunden zu gewährleisten.